Hoy se celebra el Día Mundial de la Ciencia para la Paz y el Desarrollo. Según la ONU, se busca promover «que los ciudadanos estén informados sobre los avances científicos, creando sociedades más sostenibles, al tiempo que favorece la comprensión sobre la fragilidad del planeta en el que vivimos».

Para concientizar sobre la importancia de la ciencia, hemos propuesto un debate con tres profesores de la Universidad Europea del Atlántico (UNEATLANTICO) sobre la ética en la inteligencia artificial (IA).

El tema analizado es fundamental para anticipar y abordar los desafíos que esta tecnología plantea. Es necesario involucrar a expertos de diversas disciplinas, así como a la sociedad en general, para encontrar soluciones que promuevan el desarrollo responsable y ético de la IA, teniendo siempre en cuenta el bienestar y los valores fundamentales de los seres humanos.

Participantes del debate

Manuel Masías Vergara – Director de la Escuela Politécnica Superior.

Pablo Oria – Profesor en la Escuela Politécnica Superior.

Susana Pulgar – Profesora en la Facultad de Ciencias de la Salud.

¿Cuáles son los principales desafíos éticos que enfrenta la inteligencia artificial en la actualidad, especialmente en el campo de las ciencias?

Manuel Masías:

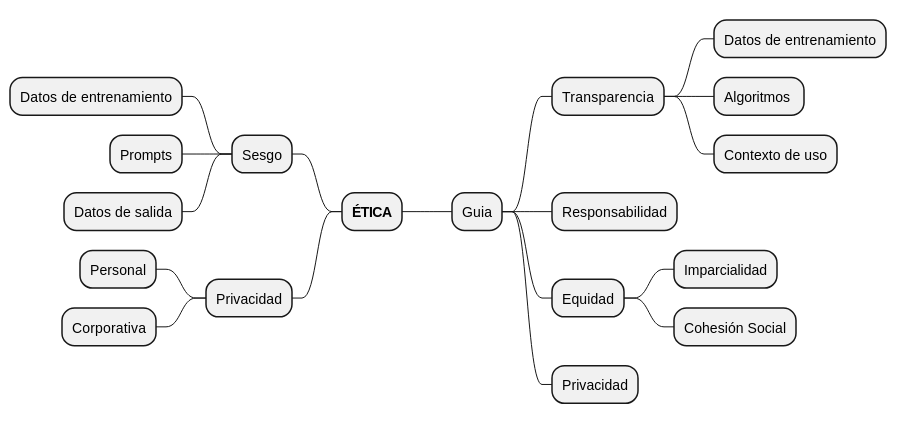

Hace unos meses preparé este esquema, al respecto de esta pregunta:

Pablo Oria:

Los seres humanos desarrollamos unos valores éticos y derechos fundamentales. Mientras no se establezcan unos principios sólidos en el desarrollo y la programación de estas aplicaciones, la ética en la ciencia no estará asegurada.

Susana Pulgar:

Los principales desafíos a los que se enfrenta la IA, sobre todo en el campo de las ciencias y la investigación, serían los sesgos que se pueden ocasionar derivados de los datos heredados de los algoritmos utilizados y la responsabilidad o toma de decisiones. Esto sería un problema en el caso de que la IA pudiera tomar decisiones en campos como por ejemplo la medicina, ¿Quién sería entonces el responsable en caso de un error?

¿Cuál es su opinión sobre las implicaciones éticas de utilizar algoritmos de inteligencia artificial en la toma de decisiones en la investigación científica?

Pablo Oria:

Una aplicación informática, hoy por hoy, no puede sustituir el poder de razonamiento conjugado con la ética en la toma de decisiones. La toma de decisiones, implica factores tanto intrínsecos como externos.

Susana Pulgar:

La utilización de algoritmos de IA en la investigación científica ofrece ventajas y desafíos éticos. Para abordar estas implicaciones éticas, es importante establecer estándares éticos, promover la transparencia y la responsabilidad, y garantizar que los investigadores sean conscientes de las cuestiones éticas relacionadas con el uso de la IA en su trabajo. La ética debe ser un componente integral de la investigación científica para garantizar que los avances tecnológicos se utilicen de manera responsable y beneficiosa para la sociedad.

¿Cómo cree que la inteligencia artificial puede afectar la privacidad y la seguridad de los individuos en el ámbito científico?

Manuel Masías:

En las dos direcciones: de modo positivo, permitiendo detectar y anticiparse a ataques y vulnerabilidades, ofuscar información; pero también aprovechándose de la capacidad de análisis inherente a esta tecnología, para comprometer la privacidad de los datos y almacenes de datos. Es fundamental que los investigadores, desarrolladores de IA y responsables sociales trabajen conjuntamente para establecer normativas y prácticas que protejan la privacidad y la seguridad de los individuos.

Pablo Oria:

La IA puede exponer a los usuarios a una violación de su información e investigaciones. Esto se puede traducir en diversas problemáticas, por ejemplo, el espionaje científico e industrial.

Susana Pulgar:

A menudo, los individuos que contribuyen con datos, no están plenamente informados sobre cómo se utilizarán, lo que plantea cuestiones de consentimiento informado. Esta falta de transparencia puede comprometer la privacidad de los participantes en estudios científicos.

¿Qué consideraciones éticas deben tenerse en cuenta al desarrollar y utilizar sistemas de inteligencia artificial en la educación científica?

Manuel Masías:

Al desarrollar y utilizar sistemas de inteligencia artificial (IA) en la educación científica, es crucial tener en cuenta una serie de consideraciones éticas. Estas consideraciones se derivan no solo de los desafíos generales de la IA, sino también de las especificidades del contexto educativo. Las decisiones éticas deben ser tomadas y evaluadas cuidadosamente por todos los actores involucrados, incluyendo desarrolladores, educadores, estudiantes y responsables de políticas educativas.

Pablo Oria:

Es complicado dirimir todas las consideraciones éticas, pero nos podemos fijar en algunas de ellas, como la igualdad, seguridad, privacidad, etc.

Susana Pulgar:

Creo que el principal problema en relación con la educación y la IA es que esta última es capaz de automatizar ciertas tareas, por lo que es fundamental que la educación científica siga promoviendo el desarrollo de habilidades críticas en los estudiantes, como el pensamiento crítico y la resolución de problemas. Además, debemos tener en cuenta que no todos los estudiantes tienen el mismo acceso a la tecnología, por lo que el uso de la IA en la educación debe ser implementado de manera que no amplíe las brechas existentes en el acceso a la educación.

¿Cuál es la importancia de la diversidad de género en los equipos de investigación científica que desarrollan tecnologías de inteligencia artificial?

Pablo Oria:

Es vital la diversidad de género para promover la igualdad, consideración ética irrenunciable en el desarrollo de la IA Avanzamos hacia una sociedad igualitaria, por lo que este factor es importantísimo.

Susana Pulgar:

La diversidad de género en los equipos de investigación científica que desarrollan tecnologías de inteligencia artificial es esencial para abordar los desafíos éticos y técnicos de manera más completa y equitativa, para garantizar que la tecnología sea más inclusiva y para inspirar a las futuras generaciones de científicas e ingenieras. Es fundamental reconocer y valorar la diversidad en la investigación de IA para impulsar avances tecnológicos y éticos significativos.

¿Cuáles son los posibles impactos positivos y negativos de la inteligencia artificial en la promoción de la paz y el desarrollo sostenible en tu área específica?

Manuel Masías:

Como toda herramienta, el uso que le demos determinará el impacto: estos (y también otros valores) se convierten en ventajas cuando se desarrollan en un entorno con acceso al conocimiento y la información, con el conocimiento de las ventajas que ofrece ejercerla, la posibilidad de realizarlo y la voluntad de hacerlo.

Pablo Oria:

Una buena programación de los valores éticos adecuados, promoviendo la igualdad, la paz y la sostenibilidad, nos puede conducir a un modelo más justo. En el caso de la agricultura y la ganadería, el uso del agua de forma sostenible y equitativo por poner un ejemplo, sería un eje primordial para conseguir un efecto positivo con la IA. Como efectos negativos tendríamos que esta IA contribuyese al mantenimiento de esta desigualdad que hoy existe.

Susana Pulgar:

La inteligencia artificial posee el potencial de generar mejoras significativas en la promoción de la paz y el desarrollo sostenible en las Ciencias de la Actividad Física y el Deporte al perfeccionar el rendimiento, prevenir lesiones y adaptar el ejercicio físico de manera personalizada. No obstante, resulta imperativo gestionar con responsabilidad la incorporación de la IA para mitigar posibles efectos negativos, tales como la privacidad de los datos, la excesiva dependencia tecnológica que podría llevar a la desatención de habilidades y conocimientos tradicionales, así como el riesgo de una excesiva automatización que podría reducir la importancia de la intuición, las emociones y la interacción social en la experiencia deportiva.